Blanchiment d'argent basé sur l'IA : Deepfakes et technologie IA versus solutions LBC-FT

Le développement rapide des technologies basées sur l’intelligence artificielle (IA) a entraîné des bouleversements significatifs dans le secteur financier, mais il a également ouvert de nouvelles opportunités pour les criminels cherchant à blanchir de l’argent. Parmi ces technologies, les deepfakes occupent une place de choix en raison de leur capacité à générer de faux contenus ultra-réalistes. La combinaison des deepfakes et des modèles avancés d’IA bouleverse les approches traditionnelles de lutte contre le blanchiment d’argent et le financement du terrorisme (LBC-FT).

Dans cet article, nous examinerons comment les technologies IA, lorsqu’elles sont utilisées à des fins illicites, transforment les méthodes de blanchiment d’argent. Nous verrons également comment des solutions basées sur l’IA permettent de lutter contre ces nouvelles formes de criminalité financière, en mettant en avant l’intégration de l’apprentissage automatique, des bases de données en graphes, et des modèles avancés d’analyse prédictive pour contrer cette menace émergente.

Les deepfakes et l'IA : un défi sans précédent pour la lutte contre le blanchiment d'argent

L'utilisation criminelle des deepfakes pour tromper les systèmes KYC et CDD:

Les deepfakes sont des médias manipulés à l’aide de réseaux génératifs adversaires (GAN), une forme d’intelligence artificielle où deux modèles d’IA s’affrontent : un générateur qui tente de créer des faux convaincants et un discriminateur qui cherche à identifier ces faux. Ce processus permet de générer des contenus de plus en plus réalistes, qu’il s’agisse de vidéos, d’audios ou d’images. Cette technologie, si elle est principalement connue pour sa capacité à créer de fausses vidéos de célébrités – parce qu’avouons-le, tout le monde a vu au moins une vidéo deepfake de Beyoncé ou J.Lo danser sur TikTok – est devenue une arme de choix dans le domaine du blanchiment d’argent.

Les criminels exploitent les deepfakes pour falsifier des documents d’identité, générer des vidéos d’individus fictifs ou usurper l’identité de personnes réelles lors des processus de vérification KYC (Know Your Customer) ou du devoir de vigilance client. Ces vidéos permettent de tromper les systèmes de reconnaissance faciale ou d’autres dispositifs d’authentification biométrique qui sont pourtant utilisés pour sécuriser l’accès aux services financiers.

Prenons l’exemple d’un criminel qui souhaite blanchir de l’argent en créant un faux profil bancaire dans un pays à réglementation faible. À l’aide de deepfakes, il peut générer une vidéo crédible simulant un appel vidéo de vérification d’identité, où un individu fictif interagit en temps réel avec un représentant de la banque. Cette capacité à usurper des identités avec des deepfakes réduit considérablement l’efficacité des systèmes AML traditionnels, car les processus de vérification ne peuvent plus uniquement se baser sur la détection visuelle de fraudes.

Automatisation de la structuration des transactions par l’IA:

Une autre dimension de l’utilisation de l’IA dans le blanchiment d’argent est la capacité des criminels à automatiser la structuration des transactions illicites via des algorithmes sophistiqués. Les criminels utilisent l’IA pour découper des montants importants en transactions de faible valeur – une technique connue sous le nom de « smurfing » – et les répartir à travers plusieurs comptes, souvent dans différents pays. Grâce à l’apprentissage automatique, ces systèmes peuvent analyser des historiques transactionnels massifs pour identifier les chemins les moins risqués ou détectables.

Ces algorithmes ne se contentent pas de structurer les transactions de manière plus efficace, ils sont également capables d’adapter continuellement leur comportement en fonction des réponses des systèmes AML. Par exemple, un modèle d’IA peut analyser les schémas de détection d’une banque ou d’un régulateur spécifique et ajuster la vitesse, la fréquence et la géolocalisation des transactions pour minimiser les risques de détection.

Les IA malveillantes s’appuient sur des techniques de renforcement (reinforcement learning) pour apprendre à optimiser les mouvements financiers illicites en temps réel, rendant les systèmes traditionnels de lutte contre le blanchiment d’argent et le financement du terrorisme obsolètes.

Problématiques institutionnelles face à l’évolution de l’IA criminelle

IA malveillante et perturbation des systèmes AML basés sur des règles:

Les systèmes traditionnels de lutte contre le blanchiment d’argent fonctionnent principalement à partir de règles prédéfinies. Par exemple, lorsqu’un certain montant est transféré entre plusieurs comptes ou qu’un client effectue des transactions inhabituelles, cela déclenche une alerte. Cependant, ces systèmes basés sur des règles sont de plus en plus inefficaces face aux schémas transactionnels sophistiqués générés par les IA.

Les IA criminelles, capables de simuler des schémas comportementaux complexes, peuvent échapper aux systèmes de détection car elles imitent presque parfaitement les comportements financiers légitimes. Ces technologies utilisent des algorithmes sophistiqués pour générer des transactions qui respectent toutes les règles en place, tout en dissimulant les véritables intentions derrière ces mouvements de fonds. Par exemple, une IA peut créer un réseau de transactions fractionnées où chaque mouvement, pris individuellement, semble anodin, mais où l’ensemble participe à une opération de blanchiment d’argent de grande envergure.

Biais dans la détection des anomalies : un défi supplémentaire:

Les systèmes AML basés sur des règles peuvent être facilement dépassés par la capacité de ces IA malveillantes à générer des comportements transactionnels qui restent en deçà des seuils de déclenchement d’alertes. Les modèles d’apprentissage automatique non supervisé sont souvent utilisés par les régulateurs et les institutions financières pour détecter des anomalies dans les transactions, mais ces modèles peuvent être biaisés ou perturbés par des données massives générées artificiellement par des deepfakes ou d’autres types de contenus falsifiés.

Un autre problème lié à l’utilisation de l’IA malveillante réside dans la vitesse à laquelle ces modèles peuvent s’adapter. Lorsqu’une anomalie est détectée, le système peut rapidement changer de stratégie et modifier le schéma des transactions pour éviter d’être identifié à l’avenir. Cette capacité à évoluer continuellement rend la lutte contre le blanchiment d’argent extrêmement complexe pour les institutions qui ne sont pas équipées de solutions technologiques de pointe.

Solutions avancées LBC-FT basées sur l’IA : L’IA contre l’IA

Les institutions financières et les régulateurs doivent aujourd’hui faire face à des cybercriminels sophistiqués qui exploitent les technologies de deepfake et d’autres algorithmes malveillants pour contourner les systèmes de conformité. Afin de contrer ces menaces, plusieurs technologies d’IA avancées sont déployées pour renforcer la détection et la prévention du blanchiment d’argent.

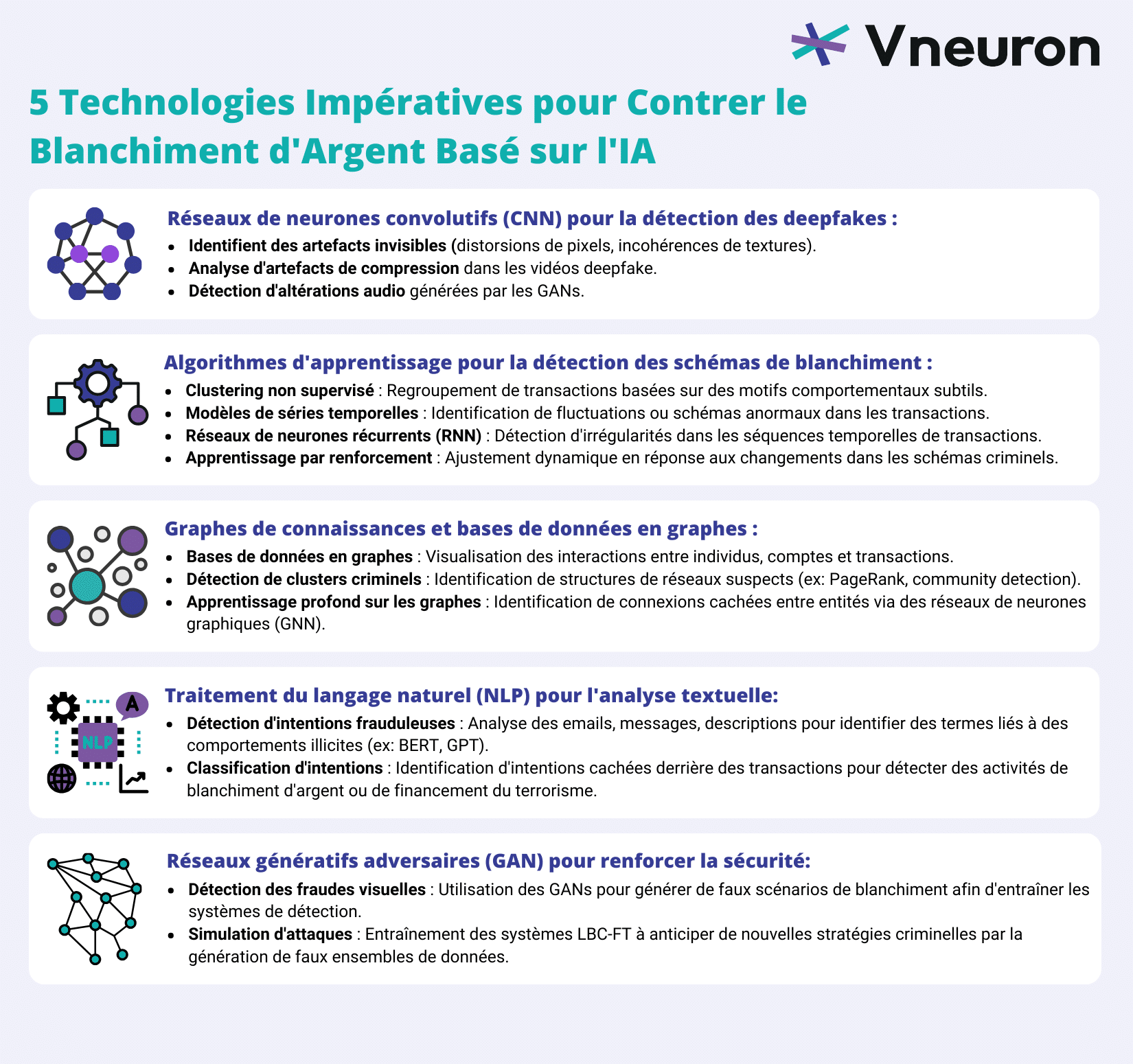

Les réseaux de neurones convolutifs (CNN) pour la détection des deepfakes

Ce type de réseau d’apprentissage profond excelle dans la détection de motifs complexes, notamment en analysant les images et les vidéos. Pour lutter contre les deepfakes, les CNN sont entraînés à identifier des artefacts invisibles à l’œil humain, tels que les distorsions de pixels ou des incohérences dans les textures.

- Analyse d’artefacts de compression : Les CNN peuvent repérer les traces de compression des vidéos modifiées, caractéristiques des deepfakes, en détectant des anomalies qui échappent aux vérifications humaines.

- Détection des altérations audio : Ces réseaux peuvent également être utilisés pour l’analyse audio en identifiant des distorsions subtiles générées par les GANs lors de la synthèse de voix ou de conversations.

Algorithmes d'apprentissage supervisé et non supervisé pour la détection prédictive des schémas de blanchiment

- Clustering non supervisé : Les algorithmes d’apprentissage non supervisé, tels que le k-means ou les cartes auto-organisatrices, permettent de regrouper des transactions en fonction de motifs comportementaux subtils qui ne sont pas immédiatement apparents. Ce processus aide à identifier des schémas de blanchiment complexes orchestrés sur plusieurs comptes ou entités.

- Modèles de séries temporelles : L’analyse des séries temporelles permet de détecter des anomalies récurrentes, telles que des fluctuations inhabituelles dans les volumes de transactions ou des schémas répétitifs, qui pourraient indiquer des cycles de blanchiment d’argent.

- Réseaux de neurones récurrents (RNN) : Les RNN, et en particulier leurs variantes avancées comme les LSTM (Long Short-Term Memory), sont capables d’analyser les séquences temporelles de transactions et de repérer des irrégularités sur des périodes prolongées, anticipant ainsi des comportements suspects.

- Apprentissage par renforcement : Les systèmes basés sur l’apprentissage par renforcement adaptatif peuvent ajuster leurs modèles de détection de manière dynamique en réponse aux changements dans les schémas criminels, en apprenant de nouvelles tactiques de blanchiment au fur et à mesure qu’elles émergent.

Graphes de connaissances et bases de données en graphes pour la cartographie des réseaux criminels

- Bases de données en graphes : Ces bases de données modélisent les entités et leurs relations sous forme de nœuds et d’arêtes, permettant de visualiser les interactions complexes entre individus, comptes bancaires et transactions. Les algorithmes d’apprentissage automatique peuvent détecter des anomalies relationnelles, telles que des transferts répétitifs entre entités apparemment non reliées.

- Détection de clusters criminels : Les algorithmes d’analyse de graphe, tels que PageRank ou community detection, peuvent identifier des structures de réseau inhabituelles, comme des clusters ou des chaînes de transactions, caractéristiques de réseaux de blanchiment d’argent.

- Apprentissage profond sur les graphes : L’intégration d’algorithmes d’apprentissage profond, tels que les réseaux de neurones graphiques (GNN), permet d’identifier des connexions cachées entre les entités, même dans des réseaux de transactions financièrement discrets mais interconnectés de manière criminelle.

Techniques avancées de traitement du langage naturel (NLP) pour l'analyse des interactions textuelles

- NLP et détection des intentions frauduleuses : Le traitement du langage naturel, en utilisant des modèles tels que BERT ou GPT, peut analyser des communications textuelles (emails, messages, descriptions de transactions) pour identifier des termes ou des expressions liés à des comportements illicites.

- Classification d’intentions : Les modèles NLP peuvent classifier les interactions textuelles pour identifier des intentions cachées derrière des transactions, détectant ainsi des discussions potentiellement liées à des activités de blanchiment d’argent ou de financement du terrorisme

Utilisation de réseaux génératifs adversaires (GAN) pour le renforcement de la sécurité

- GANs pour la détection des fraudes visuelles : Les GANs, utilisés pour créer des deepfakes, sont également utilisés à des fins défensives. Les institutions financières forment des GANs à générer de faux scénarios de blanchiment d’argent pour entraîner leurs systèmes d’IA à les reconnaître.

- Simulation d’attaques pour renforcement de l’apprentissage : En générant des faux ensembles de données, les systèmes LBC-FT peuvent s’entraîner à anticiper les nouvelles stratégies des criminels, améliorant ainsi leur capacité de détection proactive.

Limites et défis de la mise en œuvre de l'IA dans les systèmes LBC-FT

L'intégration de systèmes multi-modaux pour une détection holistique

Bien que l’IA présente des solutions puissantes pour la détection de schémas complexes, son déploiement au sein des systèmes LBC-FT n’est pas sans défis. Les systèmes multi-modaux, capables d’analyser simultanément des données textuelles, visuelles, transactionnelles et comportementales, sont encore en phase de développement et nécessitent des infrastructures technologiques sophistiquées pour être pleinement efficaces. Ces solutions doivent intégrer des flux de données provenant de différentes sources (banques, régulateurs, services de renseignement) tout en respectant les réglementations sur la confidentialité des données.

L'adoption de modèles auto-apprenants pour faire face à l’évolution constante des menaces

Les solutions futures doivent impérativement intégrer des modèles auto-apprenants capables d’évoluer avec les menaces. Les IA criminelles changent rapidement de stratégie et de technique, ce qui nécessite des systèmes LBC-FT capables de détecter et de s’adapter de manière autonome aux nouvelles menaces sans intervention humaine constante. Cela passe par la mise en place de systèmes de reinforcement learning ou d’apprentissage fédéré, où plusieurs institutions financières partagent des modèles d’IA entraînés de manière collaborative sans pour autant exposer leurs données sensibles.

Défis liés à l'interprétabilité des modèles d'IA

L’un des plus grands défis des systèmes LBC-FT basés sur l’IA est l’interprétabilité des modèles. Les algorithmes d’apprentissage automatique, notamment ceux utilisés pour la détection d’anomalies complexes, fonctionnent souvent comme des “boîtes noires”, où il est difficile d’expliquer comment une décision a été prise. Cette opacité peut créer des problèmes de conformité pour les régulateurs, qui exigent des justifications claires pour les alertes de blanchiment d’argent et les décisions qui en découlent. Il devient donc crucial de développer des méthodes d’IA explicables (explainable AI ou XAI) pour garantir la transparence des processus décisionnels dans les systèmes de conformité LBC-FT.

Gestion de la qualité des données

Un autre défi majeur dans l’implémentation de l’IA dans les systèmes LBC-FT réside dans la gestion de la qualité des données. Les modèles d’apprentissage automatique reposent sur des données massives et variées, mais la qualité, la précision et la cohérence de ces données peuvent poser problème. Des jeux de données incomplets ou biaisés peuvent entraîner des résultats incorrects, des faux positifs ou, pire encore, des faux négatifs. Garantir des données de haute qualité est une tâche complexe, nécessitant une collaboration continue entre les banques, les régulateurs et les fournisseurs de solutions technologiques.

L’avenir de la lutte contre le blanchiment d’argent et le rôle crucial de l'IA

Vers une régulation proactive et une collaboration internationale accrue

- Dans un futur dominé par des technologies toujours plus complexes, les régulateurs devront anticiper et s’adapter plus rapidement aux nouvelles menaces. La surveillance réactive ne suffira plus ; une régulation proactive sera nécessaire pour détecter les schémas émergents en temps réel.

- Les collaborations internationales seront essentielles, notamment pour échanger des informations sur les dernières méthodes criminelles et les solutions innovantes. Le partage des connaissances sur l’IA entre régulateurs, institutions financières et technologiques deviendra une norme pour contrer efficacement les menaces mondiales.

- Les réglementations doivent inclure des cadres robustes pour régir l’utilisation des solutions d’IA dans la détection des fraudes. Ces cadres devront être flexibles pour permettre une évolution rapide en fonction des avancées technologiques.

L’intelligence artificielle hybride : une symbiose entre l’IA et l’expertise humaine

- La prochaine génération de systèmes anti-blanchiment reposera sur l’intelligence artificielle hybride, combinant divers types d’apprentissages — supervisé, non supervisé et par renforcement — pour détecter des menaces en constante évolution.

- L’IA hybride permet de créer des modèles capables d’évoluer face aux nouvelles techniques de blanchiment, tout en offrant la possibilité aux analystes humains de superviser et d’affiner les modèles d’IA pour des résultats plus précis.

- Dans cette approche future, l’IA ne se contentera plus de détecter des anomalies : elle sera capable de comprendre et prédire les intentions des criminels grâce à l’analyse comportementale avancée et au traitement du langage naturel (NLP), tout en bénéficiant d’une validation humaine pour assurer une détection ultra-fiable.

Automatisation complète et réactivité instantanée

- À l’avenir, les systèmes de LBC-FT basés sur l’IA évolueront vers une automatisation presque complète, éliminant les processus manuels lents qui peuvent ralentir les enquêtes sur les crimes financiers. Ces systèmes réagiront en temps réel aux menaces détectées, avec une capacité d’auto-correction et de mise à jour immédiate de leurs algorithmes en fonction des nouvelles stratégies employées par les criminels.

- Des technologies telles que l’apprentissage fédéré permettront de partager des modèles d’IA entre plusieurs institutions sans compromettre la confidentialité des données. Cela améliorera la réactivité du système global sans nécessiter une centralisation des informations sensibles.

Anticipation des menaces liées aux deepfakes et IA criminelles

- Les deepfakes et autres formes de falsifications basées sur l’IA, comme l’usurpation d’identité par des vidéos réalistes, deviendront des armes de plus en plus utilisées par les criminels. Dans le futur, il ne suffira pas de détecter ces falsifications à posteriori ; les systèmes devront être capables de les bloquer en temps réel.

- L’IA avancée, notamment à travers les réseaux de neurones convolutifs (CNN) et les réseaux génératifs adversaires (GANs), jouera un rôle crucial pour identifier et neutraliser ces menaces. Les systèmes devront évoluer en permanence, à l’instar des attaques criminelles, et utiliser des modèles d’IA auto-apprenants qui s’améliorent à chaque nouvelle tentative de fraude.

- La capacité de l’IA à comprendre et interpréter les interactions complexes, à travers des graphes de connaissances, permettra de décoder des réseaux financiers criminels entiers, facilitant ainsi la découverte de blanchiments d’argent de grande envergure, qui resteront autrement invisibles.

Face à l’essor des deepfakes et des IA criminelles, la lutte contre le blanchiment d’argent doit évoluer pour contrer ces nouvelles menaces. Les technologies avancées comme les réseaux de neurones convolutifs (CNN) et les graphes de connaissances permettent aux institutions financières d’anticiper les comportements criminels et de renforcer leurs systèmes LBC-FT.

Pour vous préparer à ces défis, l’adoption de solutions technologiques robustes et évolutives est cruciale. Vneuron offre des outils de conformité basés sur l’IA qui peuvent être adaptés aux besoins spécifiques de votre organisation. Contactez-nous pour découvrir comment nos solutions LBC-FT peuvent vous aider à renforcer vos systèmes de détection et de prévention.